月: 2023年8月

The Distance Between 0 and 1

今回はちょっと長文になります。前回のAIの流れから、マシンと人間と音楽の話です。

この動画は、私が好きなドラマーのJoJo Mayer氏が、電子音楽から新たに派生したジャングルやドラムンベースというジャンルから、ドラマーとしての人生を変える衝撃的な出会いがあったことを、あのプレゼンテーションで有名なTEDで語ったものです。(クール!)

ドラムマシンにプログラムされた人間の能力を超える演奏を彼曰くリバースエンジニアリングし、これを模倣して即興演奏することで、新しいスタイルが確立したことについてデモ演奏を交えて、知的に語られています。本来ドラムマシンは人間の演奏をシミュレートする存在ですが、ドラムマシンの演奏を人間が模倣するということから、リバースエンジニアリングという言葉を使っていると思います。

ドラムンベースは元々好きなジャンルで、彼のバンドNerveでこれをアコースティックドラムでプレイしているのを初めて動画で見た時は、これやりたかったやつだ、と思い一気にファンになりました。

最近、上記動画でドラムンベースをフィンガードラムで懐かしんでプレイしたり、ある本を読んだり、YMO ユキヒロ氏の逝去でマシンフレーズを模倣した動画を作成したことから、いろいろなスイッチが入り、TEDプレゼン動画を題材にブログを書いてみました。

TED動画から引用

「ドラムマシンにプログラムされた作り込まれた演奏と、即興演奏との創造的プロセスにある違いに答えが隠されている。」

「即興演奏では、意思決定が速ければ速いほど楽しく、力がみなぎるように感じる。」

「意思決定プロセスが意識的に処理できないレベル ゾーンに入る。」

ジャングルはプログラミングによるものや、フレーズサンプリングしたものを倍速で再生するものがあり、テンポが非常に速いです。マシンサウンドなので当然ですが、演奏できることを考えていません。

このテンポの曲で、即興性を取り入れてプレイするということは、かなり難易度が高いことはわかります。これがまさにここで言っている意識的に処理できないレベル「ゾーンに入る」ということでしょう。

下記の動画では、マシンフィールを意識したまま、ドラムソロを叩くというすごいプレイがあります。(動画最終部分)

人間的なドラムソロをやる部分もありすが、機械っぽいフレーズを多用しています。後者の方がきっと難しい、というかきついと思います。

TED動画から引用

「デジタル文化のリバースエンジニアリングを続けた結果、「0」と「1」の間の違いや距離に注目するようになりました。おかげで口では説明できない自らの創造性の源と人間の存在の理解に限りなく近づくことができました。ここまでにお話ししたことの意味が皆さんにも伝わるように、今から短い即興演奏をお見せします。」

このように語って最後の演奏に入っていきます。

言葉では十分説明できないから、演奏で説明するぜみたいな、なんともカッコいい・・

実は、JoJo 氏、ユキヒロ氏と幾つか似ている点があると思っています。

マシンフィール以外にも、テクニックについての考え方です。「曲に必要なテクニック」であることです。どちらもドラマーというより、アーティストです。トラディショナルな音楽をベースに置きつつも、新しい音に敏感にであり、それを使った音楽を大胆に実現します。ドラムセットのスタイルがある一時ですが似ていると感じた部分があります。JoJo 氏は、上記動画ではTomがBDの上にセットされる伝統的なスタイルをとっていますが、TomをおかずClosedHHなどの金物をおくスタイルのNerveの動画もたくさん見かけました。またユキヒロ氏も、初期YMOの時代、フロントエンドは全てシンセドラムパッドという構成をとっていたことがあります。BDの上にTomがないセットというのは、ドラマーとしてすごく制約を感じるものです。(ビートマシン化する)逆に言えば、Tomなしセットは、スタイルをがらっと変えられるとも言えます。

あとドラム音色のこだわりが両氏ともすごいです。ユキヒロ氏は電子音やエフェクト音について、クールな音をたくさん作り出しました。JoJo氏のすごいところは、それをアコースティック楽器で実現するところです。サイドSDにリング状のシンバルを重ねたりなど、ほとんどオリジナル楽器です。

BD4分打ちリズムのクラブサウンドではスネアを使い分け、グルーブをだしたりしています。

通常Roland TR-909 BD系の4分ダンスビート曲は、その音色自体が重要なのでアコースティックが入る余地はないのですが、太いアナログベースのNerveの楽曲に、JoJo氏の研究されたプレイが乗ると十分アコースティックでもいけています。これもリバースエンジニアリングの結果として個人的に衝撃的な出来事と感じました。

動画に戻りますが、タイトルの”between 0 and 1″と言っている部分、デジタルかアナログか、と言っていないことが気になりました。先に、意識的に処理できないレベル、について少し触れましたが、処理速度に関して言っているのなら、量子コンピュータを連想させます。ただ単に分解能のことかもしれませんが、それだとゾーンに入る、などという深い意味にならないような気がしたからです。(余談ですがKorgのVolca Drumではフレーズを確率で変化させることができあます。これだけでも即興に近い印象を感じます。ちなみに関係ないですが量子コンピューターは確率を使って計算をします。)

最近ジョージ・ダイソン氏の「アナロジア」という本を読みました。奇しくも帯には「0と1に寄らない計算は人類に何をもたらすか?」「ポストAI時代の予言書」とあります。著者のインタビュー動画がありますので最後に引用しておきます。

私がこれを読んで感じたのは、自然とか人間にもう一度目を向けることの重要性です。技術的にはデジタルよりも高性能なアナログコンピュータについて書かれていますが、(といってもほとんどは自然界の話)これはナチュラルコンピュータと言われるものと同義だと思っています。量子コンピュータもその一種ですが、自然界が行なっている計算の方が人間が作るコンピュータよりはるかに速いということです。(デジタルコンピュータはシリアライズという特徴を持つため)

量子の自然現象としての演算について、下記動画は私の理解を深めてくれました。

【誰でも量子コンピュータ!量子機械学習編】Quantum Computing for You【第3回・9/22実施】

イジングモデルと組合せ最適化問題の対応

過去関連記事)

「量子コンピュータプログラミング」

https://decode.red/ed/archives/1421

「Qiskit」

https://decode.red/blog/202301151549/

「Quantum Computer」

https://decode.red/blog/202301031525/

「Artificial Life」

https://decode.red/net/archives/560

「Cellular Automaton」

https://decode.red/net/archives/547

「アナロジア」から引用

「人間の言語は、独立したジェスチャーの連続から進化したもの、あるいはそれと共進化したもので、ノイズの多い低周波帯域での貧弱な伝送に耐えるように最適化されている。このようは制約を受けない知性の間では、まったく異なる言語が生まれるかもしれない。クジラがコミュニケーションをとっていることは間違いない。しかし彼らはわれわれが言語で考えを伝える時のように、知能を不連続の記号の連なり変換する必要はない。われわれが音楽を演奏するとき、クジラは「やっとわれわれと同じようにコミュニケーションしようとする兆しが見えた!」と思っているかもしれない。」

自然界はもっと高度はコミュニケーション(あえて通信と言った方がテクニカルに感じやすいかも)をしているのでしょう。音楽によるコミュニケーションは即興演奏などで体験できます。言葉より具体的な意思の伝達には不自由かもしれませんが、先にJoJo氏が言ったように言葉では説明できないことも伝えることができます。これは本当に興味深いことです。

むしろ言葉には誤解がつきもののことを考えると、言葉より優れているのかもしれません。音楽や絵画などのアートによる非言語の伝達手段というものを人間がさらに身につけることができれば、相互理解能力が高まり、その結果さまざまな誤解を減らすことができるかもしれませんね。

即興演奏によるコミュニケーションの速度は、現在のデジタルコンピュータでいかにプログラミングしようとも(何台もネットワーク化しても)、人間にはかなわないだろうという感覚があります。コンピュータはバッファリングによる遅延というハンデがあったり、人間の先読みする能力までシミュレーションする必要があります。(ニューラルネットワークアナログチップのようなものが必要)

人間の能力が奏でる音楽を機械で模倣し、またその音楽を人間が模倣して新しい音楽が生み出されました。身体性が音楽に影響を与えてるでしょうし、音楽が身体性にも影響を与えます。(ドラムンベースで先の「曲に必要なテクニック」といわれるものを考えたとき、Push-Pull奏法というものが使われています。コツをつかむのが難しいのですが、片手で高速に連打できます。これをJoJo氏は足でもやっている。)将棋AIが棋士に変化をもたらすように、テクノロジーが進むとともに人間の感性も変化していくことでしょう。そして次の音楽は・・また別のレイヤーでの人間からマシンに対するアプローチだと思っています。つまり行ったりきたりするわけですね。

最後になりますが、おまけとして追記します。

マシンフィールのプレイの難しさを実感した、動画についてです。

マシンビートを模倣したことで新しい奏法に挑戦しました。珍しくコメントをたくさんいただき恐縮です。

今回の話題にもつながるので、この動画に込めた意味も少しお話しします。

動画と撮ろうと思った動機は、もちろん多大な影響を受けたミュージシャンのユキヒロ氏の逝去で、このタイミングに何か爪痕を残したいと思ったからです。選曲したU.Tは、とても興味深い位置付けの曲なので選びました。この曲はライブでは演奏されたことがない曲です。ドラムはもともと8ビートのパターンを、16分音符分ディレイをかけているため、音数が倍になり16ビートのリズムになっています。元が8ビートなのでテンポの速く、ドラムセットで再現するには、かなり悩むパターンです。最終的に、手で16ビートをシングルストロークで叩くのは、きついのでダブルストロークを混ぜました。そうするとBDのシングルストロークに合わせるのが辛くなりますが、この方法にしました。(テクノは修行)

次はイントロですが、ここではマーチングドラムのエッセンスが入っています。JoJo氏がジャングルやドラムンベースを即興でドラムプレイしたいと思うのと同様、このエッセンスをドラムセットでプレイしたい、という思いが長年ありました。(奇しくもJoJo氏のプレイの中にもマーチングフィールがよく見られます。ハイピッチSD上のスティックショットなど)このセットは通常のツインペダルで叩くBDの他に、その左右にBDペダルを置いて音程感のあるBDの演奏ができるセットになっています。YMOの楽曲には、Roland TR-808のBDやTomを使った音程感のあるシーケンスフレーズがよくあります。UTのイントロも同様で、この音はマーチングの音程感のあるBDの音とよく似ているのです。そこで今回これの一部を使ってイントロを再現しました。あとMC部分のクロススティキングですが、これもテナードラム(クイント、クォード)でよく使われる奏法です(太鼓が三つ横に並ぶと使える)。ルックス的にもフロントの4パッドはYMO初期のシンセパッドのオマージュです。シモンズの音は初期にはありませんでしたが、この製品があればきっと使われていたことでしょう。初期の楽曲にもマッチする不可欠の音と思っています。

長くなってしまいましたが、あのとき何を考えていたっけ、というとき思い出せるように、というつもりで書きました。

本来のブログ(Web Log)の役割とはこういうものだと、言い聞かせて。。

【ChatGPTの次はアナログ社会が来る】科学史家ジョージ・ダイソン氏の不思議なポストAIの予言/AIが自然のように成長する/人類の運命とは/難解で不思議な『アナロジア』を刊行した意義

【ChatGPTのペット化】世界的科学史家のジョージ・ダイソン氏/AIは野生化し、アナログの時代が始まる/ChatGPTの出現の希望と課題とは【後編】

Attention Is All You Need

“AI時代の生き方に、音楽は様々なヒントを与えてくれるかもしれない”

このBlogの副題ですが、それゆえAI を取り巻く話題についてこれまでも取り上げてきました。

https://beflat.iiv.jp/xml773

https://beflat.iiv.jp/xml714

ChatGPTをはじめとする生成AIについて、今回はその仕組みについて掘り下げてみました。

(仕組みをわかりやすく説明するものでなく、私が学習した備忘録のようになっています。)

タイトルは下記論文のものです。

https://arxiv.org/pdf/1706.03762.pdf

まずは用語の説明です。

GPT:Generative Pre-trained Transformer

Chat GPT :OpenAIが開発した、大規模言語モデル(LLM:Large Language Model)であるGPTを使ったチャットサービス

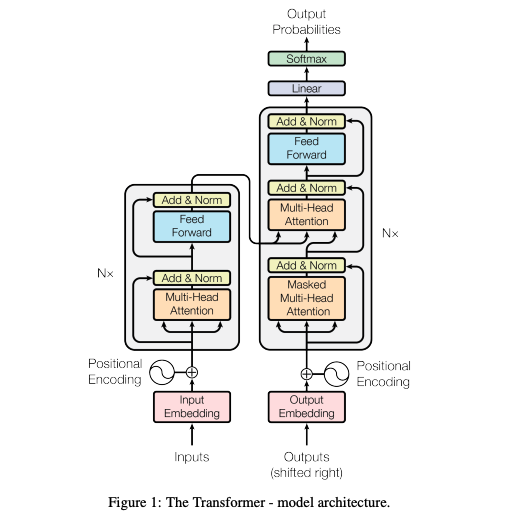

Transformer :従来から使用されてきたCNN やRNN と違い Attensionと呼ばれる仕組みに基づいたエンコーダデコーダモデル

CNN:Convolutional neural network 畳み込みニューラルネットワークといい画像や動画認識に広く使われているモデル

RNN;Recurrent Neural Network 再帰型ニューラルネットワークといい時系列データ(株価や気温の推移等)の扱いに最適

参考動画

【Transformerの基礎】Multi-Head Attentionの仕組み

https://www.youtube.com/watch?v=XOekdMBhMxU&t=166s

もともとは言語翻訳の分野で研究され、学習するときにどこに注目するか(どのデータに注意するか)といった情報が付加されることによって従来のLSTMなどによる方法より高い性能を上げられるようになりました。

これがTransformerというモデルです。ChatGPTはPre-trained(学習済み)ですので、デコーダのみを使います。

構造について論文から引用

LSTM :(Long Short-Term Memory: 長・短期記憶) ネットワークは、RNN(再帰型 ニューラル ネットワーク) の一種

LSTM の強みは、時系列データの学習や予測(回帰・分類)にあります。

一般的な応用分野としては感情分析、言語モデリング、音声認識、動画解析などがあります。 (https://jp.mathworks.com/discovery/lstm.html より)

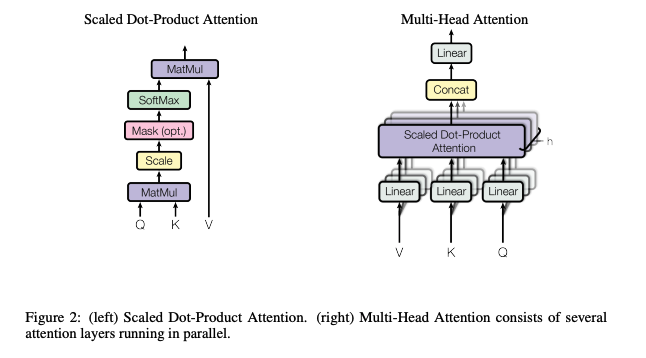

Scaled Dot-Product Attention、Multi-Head Attention、QKV

構造について論文から引用

マルチヘッドアテンションについて

https://cvml-expertguide.net/terms/dl/seq2seq-translation/transformer

“Transformerの設計は,マルチヘッドアテンションを主要ブロックとして採用したのが,最大の特徴である.マルチヘッドアテンションは「系列内自己アテンション or 系列間相互アテンション」アテンションの役割を担当する”

参考動画

https://www.youtube.com/watch?v=g5DSLeJozdw&list=PLfZJp4OG6U1Evr74E_k7P8zqb6MX9KKUZ

画像のセルフ(自己)アテンションを例にわかりやすく説明されている。

Query ,Key,Valueの違いについて

https://www.youtube.com/watch?v=50XvMaWhiTY&list=PLfZJp4OG6U1Evr74E_k7P8zqb6MX9KKUZ

V=K=Q=入力X だが これに行列をかけて回してあげる、Q ,Kそれぞれ回転させてから内積をとる、Vも回して出力調整

様々な角度からXの横ベクトルを比較して、どこに注目するかを制御して出力を決定するのが、Multi-Head Attension.

ChatGPTの仕組み

参考動画

https://www.youtube.com/watch?v=om-PZpvnCBM&list=PLfZJp4OG6U1Evr74E_k7P8zqb6MX9KKUZ&index=13&t=132s

仕組みについて理解するのは難しいですが、誤解を恐れずに言うならば、従来のLSTMでなく、TransformerのモデルがたまたまうまくいったためChatGPTのようなものが生まれた、と言えるかもしれません。(必要なのはアテンションだけ。構造に能力が宿るのだろうか・・これがすごく気になります)

ニューラルネットワーク自体、人間の脳の仕組みを模倣したものをコンピュータ上に実装しています。これを使うと画像認識など、データから答えを求めることができてしまいますが、なぜその答えが出たのか、そのプロセスの説明は困難です。Transformerも同じように考えられます。この先、意識は? 感情は? といったもの(モデル?)についても研究が進むのでしょう。 (偶然、感情に適したモデル(構造)ができちゃった、なんてことがあるかも・・)

さて、ここからが本題ですが、楽器などを練習していて思うのが、これってリアルディープラーニングかも、と思うことがあります。(もちろん人間が本家なのでおかしな言い方ですが)

同じフレーズを繰り返し演奏して、少しずつ上達する様子が、AI による学習に似ていると思うことありませんか?(音楽は時系列なのでRNNか)

特に、上記のセルフアテンションの仕組みを知った時、これはドラムプレイに当てはまっているのでは、と思いました。

ドラムセットをプレイするのを見て、よく手足がバラバラに動いていると思われる方は多いです。しかし実際には右手と右足、左手と左足は連動して動いていたりすることがあり、右足に注目して、右手の動きをする場合や、左足をタイムキープの軸にしたるすることがあります。

つまりどこかに注目(アテンション)するわけですが、これを変えると全く別の体の動きとなり、また新たに違うパターンとして練習をし直す必要があることがあるます。

ドラマーにしかわからないかもしれませんが、簡単な8ビートのパターンを叩いている時に、左足を4分で軽く踏んでいるとします。このとき左足を4分の裏で踏むように変えると、一気に叩けているはずの右手、右足、左手がぎこちない動きになります。(Positinal Encodingが影響するか)

筋肉の動きには問題がなくても、神経の働きが学習されていないせいなのではと思っています。

下記投稿の動画のイントロ部分もそうなのですが、Swingということで左足を裏拍で踏んだら一気に難しくなってしまいました。

https://beflat.iiv.jp/xml784

まあ飛躍的な考え方と思われかもしれませんが、脳が手足にどのように指示を出しているのか(先読み、条件反射、・・)、個人的にはとても興味深いテーマです。

AI研究が進む中、音楽が果たす役割は大きいと思います。

先ほどの、意識、感情、に続いて、創造力にもモデルがあるのだろうか。

Swing Vibes

今年も、ドラムマガジン2023誌上ドラム・コンテスト曲にトライしてみました。(Roland TD-17)

今回は好きなタイプの楽曲ということで盛り上がってしまい、欲張っていろいろなことにトライし(てしまい)ました。

一つは、以前からやりたかったチューニングタムです。アコースティックドラムでは古くはペダルがついたチューニングフロアタムなるものがありましたが、普通(?)は片方のスティックや指で、ヘッドを押さえつけたりしながら叩き、ピッチが変化した音をプレイします。今回IoTでよく使うデバイスM5StickCを使い、ピッチを変化させることを試みました。最初はTD-17にダイレクトでBLE接続を試みましたが、つながらずWindows PC 経由でコントールすることにしました。(右手首の角度でハイタムのピッチがかわります)そのため、少しレスポスが遅れるのと解像度が粗いところがあります。また発音中の音が変化しないのはちょっと残念でした。(いい感じに変化させるのは結構難しい・・Rolandさん一緒に開発しませんか?なんちゃって)

もう一つは、愛用のMicrofreakのファームウェアがversion 5になって、サンプルのリバース再生ができるようになったので使ってみました。偶然にも課題曲のイントロを聴いたとき、これしかない、という音が見つかりました。

あとはタイトルがSwing~ということもあり、久しぶりにレギュラー(トラディショナル)グリップで叩いています。レギュラーグリップでたたいてみて一つ発見がありました。エレドラの音が違うのです。メッシュヘッドの瞬発力を今までマッチドグリップが押さえつけていたのがわかります。スティックが弾みやすいため音切れが良い感触がします。(軽やか)また左手のハイタムへの移動がスムースなので最後はスティーブガッドの頭抜き6連符の連打でエキサイトしてしまいました。グリップはプレイスタイルに大いに影響を与えます。しかしこのグリップの弊害もありました。ついついスティックを回したくなりプレイにリスクが増えてしまいました。おまけでマーチングスネアでよくやヘッドを押さえつけるプレイもやりたくなり、エレドラでトライしています。(ダブルストロークの2打目、しかし効果はあまりなし)

以上、考えることがありすぎて、頭の中が大混乱しながら叩くことになりました。(最初は左手にもM5StickCをつけてスネアドラムのピッチも変化させていましたが、レスポンスが遅れることでコントロールが難しいことから断念)

しかしながら、いろいろやりながら、まだまだエレドラの面白い使い方があることがわかりました。これからどんどん追及していきたいと思っています。

Kit59 でハイタムのピッチを変化させる、MIDIメッセージデータ

[0xf0, 0x41, 0x10, 0x00, 0x00, 0x00, 0x4b, 0x12, 0x03,0x75, 0x03, 0x01, 0x00, 0x00, int(pitch/16), pitch%16, chksum, 0xf7]

ToDo ピッチダウンができなかった。

参考)

TD-17 MIDI インプリメンテーション (Version: 2.00) [PDF]

https://www.roland.com/jp/support/by_product/td-17/owners_manuals/7f9e7c7c-f6f1-4b42-8057-c721b104100f/

M5Stickについて

D5 Creation

D5 Creation